Trong khoa học máy tính, công nghệ trí tuệ nhân tạo hay AI (tiếng Anh: artificial intelligence), đôi khi được gọi là trí thông minh nhân tạo, là trí thông minh được thể hiện bằng máy móc, trái ngược với trí thông minh tự nhiên của con người. Thông thường, thuật ngữ “trí tuệ nhân tạo” thường được sử dụng để mô tả các máy móc (hoặc máy tính) có khả năng bắt chước các chức năng “nhận thức” mà con người thường phải liên kết với tâm trí, như “học tập” và “giải quyết vấn đề”.

Khi máy móc ngày càng tăng khả năng, các nhiệm vụ được coi là cần “trí thông minh” thường bị loại bỏ khỏi định nghĩa về AI, một hiện tượng được gọi là hiệu ứng AI.[3] Một câu châm ngôn trong Định lý của Tesler nói rằng “AI là bất cứ điều gì chưa được thực hiện.” Ví dụ, nhận dạng ký tự quang học thường bị loại trừ khỏi những thứ được coi là AI, đã trở thành một công nghệ thông thường. Khả năng máy hiện đại thường được phân loại như AI bao gồm thành công hiểu lời nói của con người, cạnh tranh ở mức cao nhất trong trò chơi chiến lược (chẳng hạn như cờ vua và Go), xe hoạt động độc lập, định tuyến thông minh trong mạng phân phối nội dung, và mô phỏng quân sự.

Công nghệ trí tuệ nhân tạo có thể được phân thành ba loại hệ thống khác nhau: trí tuệ nhân tạo phân tích, lấy cảm hứng từ con người và nhân tạo. AI phân tích chỉ có các đặc điểm phù hợp với trí tuệ nhận thức; tạo ra một đại diện nhận thức về thế giới và sử dụng học tập dựa trên kinh nghiệm trong quá khứ để thông báo các quyết định trong tương lai. AI lấy cảm hứng từ con người có các yếu tố từ trí tuệ nhận thức và cảm xúc; hiểu cảm xúc của con người, ngoài các yếu tố nhận thức và xem xét chúng trong việc ra quyết định. AI nhân cách hóa cho thấy các đặc điểm của tất cả các loại năng lực (nghĩa là trí tuệ nhận thức, cảm xúc và xã hội), có khả năng tự ý thức và tự nhận thức được trong các tương tác.

Công nghệ trí tuệ nhân tạo được thành lập như một môn học thuật vào năm 1956, và trong những năm sau đó đã trải qua nhiều làn sóng lạc quan, sau đó là sự thất vọng và mất kinh phí (được gọi là ” mùa đông AI “), tiếp theo là cách tiếp cận mới, thành công và tài trợ mới. Trong phần lớn lịch sử của mình, nghiên cứu AI đã được chia thành các trường con thường không liên lạc được với nhau. Các trường con này dựa trên các cân nhắc kỹ thuật, chẳng hạn như các mục tiêu cụ thể (ví dụ: ” robot học ” hoặc “học máy”),[14] việc sử dụng các công cụ cụ thể (“logic” hoặc mạng lưới thần kinh nhân tạo) hoặc sự khác biệt triết học sâu sắc. Các ngành con cũng được dựa trên các yếu tố xã hội (các tổ chức cụ thể hoặc công việc của các nhà nghiên cứu cụ thể).

Lĩnh vực này được thành lập dựa trên tuyên bố rằng trí thông minh của con người “có thể được mô tả chính xác đến mức một cỗ máy có thể được chế tạo để mô phỏng nó”. Điều này làm dấy lên những tranh luận triết học về bản chất của tâm trí và đạo đức khi tạo ra những sinh vật nhân tạo có trí thông minh giống con người, đó là những vấn đề đã được thần thoại, viễn tưởng và triết học từ thời cổ đại đề cập tới.[19] Một số người cũng coi AI là mối nguy hiểm cho nhân loại nếu tiến triển của nó không suy giảm. Những người khác tin rằng AI, không giống như các cuộc cách mạng công nghệ trước đây, sẽ tạo ra nguy cơ thất nghiệp hàng loạt.

Trong thế kỷ 21, các kỹ thuật AI đã trải qua sự hồi sinh sau những tiến bộ đồng thời về sức mạnh máy tính, dữ liệu lớn và hiểu biết lý thuyết; và kỹ thuật AI đã trở thành một phần thiết yếu của ngành công nghệ, giúp giải quyết nhiều vấn đề thách thức trong học máy, công nghệ phần mềm và nghiên cứu vận hành.

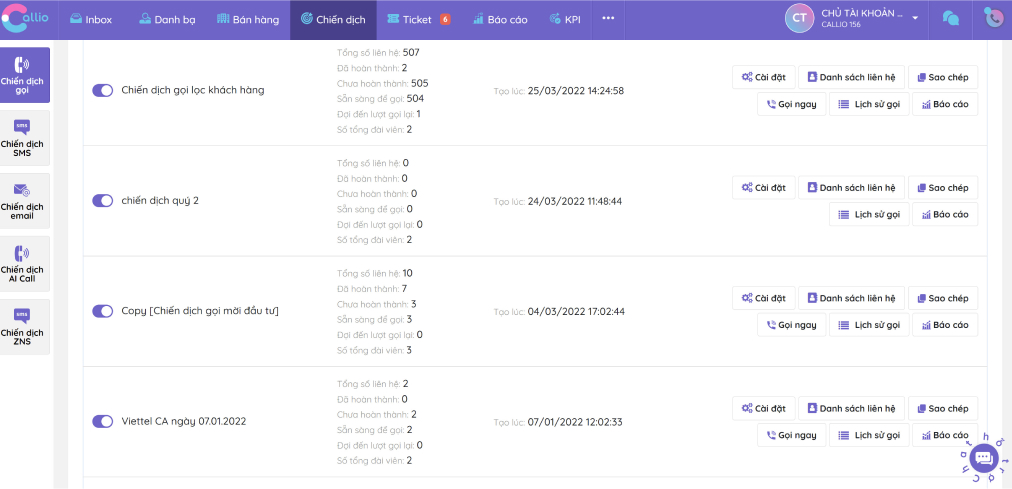

Công nghệ trí tuệ nhân tạo được áp dụng trên phần mềm tổng đài ảo thông minh của Callio

Tư tưởng có khả năng sinh vật nhân tạo xuất hiện như các thiết bị kể chuyện thời cổ đại,[22] và đã được phổ biến trong tiểu thuyết, như trong Frankenstein của Mary Shelley hay RUR (máy toàn năng Rossum) của Karel Capek.[23] Những nhân vật này và số phận của họ nêu ra nhiều vấn đề tương tự hiện đang được thảo luận trong đạo đức của công nghệ trí tuệ nhân tạo.[19]

Nghiên cứu về lý trí cơ học hoặc “chính thức” bắt đầu với các nhà triết học và toán học thời cổ đại. Nghiên cứu về logic toán học đã dẫn trực tiếp đến lý thuyết tính toán của Alan Turing, người cho rằng một cỗ máy, bằng cách xáo trộn các ký hiệu đơn giản như “0” và “1”, có thể mô phỏng bất kỳ hành động suy luận toán học nào có thể hiểu được. Tầm nhìn sâu sắc này, cho thấy máy tính kỹ thuật số có thể mô phỏng bất kỳ quá trình suy luận hình thức nào, đã được gọi là luận án Church-Turing.[24] Cùng với những khám phá đồng thời về sinh học thần kinh, lý thuyết thông tin và điều khiển học, điều này khiến các nhà nghiên cứu cân nhắc khả năng xây dựng bộ não điện tử. Turing đã đề xuất rằng “nếu một con người không thể phân biệt giữa các phản hồi từ một máy và một con người, máy tính có thể được coi là ‘thông minh’.[25] Công việc đầu tiên mà bây giờ được công nhận là trí tuệ nhân tạo là thiết kế hình thức “tế bào thần kinh nhân tạo” do McCullouch và Pitts đưa ra năm 1943.[1]

Lĩnh vực nghiên cứu AI được ra đời tại một hội thảo tại Đại học Dartmouth năm 1956. Những người tham dự Allen Newell (CMU), Herbert Simon (CMU), John McCarthy (MIT), Marvin Minsky (MIT) và Arthur Samuel (IBM) đã trở thành những người sáng lập và lãnh đạo nghiên cứu AI. Họ và các sinh viên của họ đã tạo ra các chương trình mà báo chí mô tả là “đáng kinh ngạc”: máy tính đang học chiến lược kiểm tra (c. 1954)[29] (và đến năm 1959 được cho là chơi tốt hơn người bình thường),[30] giải từ các vấn đề về đại số, chứng minh các định lý logic (Lý thuyết logic, lần chạy đầu tiên vào năm 1956) và nói tiếng Anh.[31] Đến giữa thập niên 1960, nghiên cứu ở Mỹ được Bộ Quốc phòng tài trợ rất nhiều và các phòng thí nghiệm đã được thành lập trên khắp thế giới.[33] Những người sáng lập AI rất lạc quan về tương lai: Herbert Simon dự đoán, “máy móc sẽ có khả năng, trong vòng hai mươi năm nữa, làm bất kỳ công việc nào mà một người có thể làm”. Marvin Minsky đồng ý, viết, “trong một thế hệ … Vấn đề tạo ra ‘công nghệ trí tuệ nhân tạo’ về cơ bản sẽ được giải quyết “.

Họ đã không nhận ra độ khó của một số nhiệm vụ còn lại. Tiến độ chậm lại và vào năm 1974, để đáp lại sự chỉ trích của Sir James Lighthill và áp lực liên tục từ Quốc hội Hoa Kỳ để tài trợ cho các dự án năng suất cao hơn, cả chính phủ Hoa Kỳ và Anh đều dừng nghiên cứu khám phá về AI. Vài năm sau đó sẽ được gọi là ” mùa đông AI “, giai đoạn mà việc kiếm được tài trợ cho các dự án AI là khó khăn.

Đầu những năm 1980, nghiên cứu AI đã được hồi sinh nhờ thành công thương mại của các hệ chuyên gia,[35] một dạng chương trình AI mô phỏng kiến thức và kỹ năng phân tích của các chuyên gia về con người. Đến năm 1985, thị trường cho AI đã đạt hơn một tỷ đô la. Đồng thời, dự án máy tính thế hệ thứ năm của Nhật Bản đã truyền cảm hứng cho chính phủ Hoa Kỳ và Anh khôi phục tài trợ cho nghiên cứu học thuật. Tuy nhiên, bắt đầu với sự sụp đổ của thị trường Máy Lisp vào năm 1987, AI một lần nữa rơi vào tình trạng khó khăn, và một sự gián đoạn thứ hai, kéo dài hơn đã bắt đầu.

Vào cuối những năm 1990 và đầu thế kỷ 21, AI bắt đầu được sử dụng cho hậu cần, khai thác dữ liệu, chẩn đoán y tế và các lĩnh vực khác. Thành công là nhờ sức mạnh tính toán ngày càng tăng (xem định luật Moore), nhấn mạnh hơn vào việc giải quyết các vấn đề cụ thể, mối quan hệ mới giữa AI và các lĩnh vực khác (như thống kê, kinh tế và toán học) và cam kết của các nhà nghiên cứu về phương pháp toán học và tiêu chuẩn khoa học. Deep Blue trở thành hệ thống chơi cờ trên máy tính đầu tiên đánh bại một nhà đương kim vô địch cờ vua thế giới, Garry Kasparov, vào ngày 11 tháng 5 năm 1997.

Năm 2011, tại một chương trình truyền hình thi đấu trả lời câu hỏi biểu diễn Jeopardy!, hệ thống trả lời câu hỏi của IBM, Watson, đã đánh bại hai nhà vô địch Brad Rutter và Ken Jennings, với tỷ số chênh lệch đáng kể. Máy tính nhanh hơn, cải tiến thuật toán và truy cập vào lượng lớn dữ liệu cho phép có được các tiến bộ trong học tập và nhận thức máy; phương pháp học sâu vốn đói dữ liệu bắt đầu thống trị các thử nghiệm liên quan đến độ chính xác vào khoảng năm 2012. Kinect, cung cấp giao diện chuyển động cơ thể 3D cho Xbox 360 và Xbox One, sử dụng các thuật toán xuất hiện từ nghiên cứu AI dài[41] cũng như trợ lý cá nhân thông minh trong điện thoại thông minh. Vào tháng 3 năm 2016, AlphaGo đã thắng 4 trên 5 trận đấu cờ vây trong trận đấu với nhà vô địch cờ vây Lee Sedol, trở thành hệ thống chơi cờ vây trên máy tính đầu tiên đánh bại một người chơi cờ vây chuyên nghiệp mà không cần chấp quân.[6][43] Trong Hội nghị Tương lai 2017, AlphaGo đã giành chiến thắng trong một trận đấu ba ván với Kha Khiết,[44] kỳ thủ lúc đó liên tục giữ vị trí số 1 thế giới trong hai năm.[45][46] Điều này đánh dấu sự hoàn thành một cột mốc quan trọng trong sự phát triển của công nghệ trí tuệ nhân tạo vì cờ vây là một trò chơi tương đối phức tạp, hơn cả cờ vua.

Theo Jack Clark của Bloomberg, năm 2015 là một năm mang tính bước ngoặt đối với công nghệ trí tuệ nhân tạo, với số lượng dự án phần mềm sử dụng AI Google đã tăng từ “sử dụng lẻ tẻ” vào năm 2012 lên hơn 2.700 dự án. Clark cũng trình bày dữ liệu thực tế cho thấy những cải tiến của AI kể từ năm 2012 được hỗ trợ bởi tỷ lệ lỗi thấp hơn trong các tác vụ xử lý hình ảnh. Ông cho rằng sự gia tăng các mạng thần kinh giá cả phải chăng, do sự gia tăng cơ sở hạ tầng điện toán đám mây và sự gia tăng các công cụ nghiên cứu và bộ dữ liệu. Các ví dụ được trích dẫn khác bao gồm sự phát triển hệ thống Skype của Microsoft có thể tự động dịch từ ngôn ngữ này sang ngôn ngữ khác và hệ thống của Facebook có thể mô tả hình ảnh cho người mù. Trong một cuộc khảo sát năm 2017, một trong năm công ty báo cáo rằng họ đã “kết hợp AI trong một số dịch vụ hoặc quy trình”.

Khoảng năm 2016, Trung Quốc đã tăng tốc rất nhiều tài trợ của chính phủ; với nguồn cung cấp dữ liệu lớn và sản lượng nghiên cứu tăng nhanh, một số nhà quan sát tin rằng nước này có thể đang trên đà trở thành một “siêu cường AI”. Tuy nhiên, người ta đã thừa nhận rằng các báo cáo liên quan đến công nghệ trí tuệ nhân tạo có xu hướng bị phóng đại.

Công nghệ trí tuệ nhân tạo (AI) chia thành hai trường phái tư duy: Trí tuê nhân tạo truyền thống và trí tuệ tính toán.

Công nghệ trí tuê nhân tạo truyền thống hầu như bao gồm các phương pháp hiện được phân loại là các phương pháp học máy (machine learning), đặc trưng bởi hệ hình thức (formalism) và phân tích thống kê. Nó còn được biết với các tên Trí tuê nhân tạo biểu tượng, Trí tuê nhân tạo logic, Trí tuê nhân tạo ngăn nắp (neat AI) và Trí tuê nhân tạo cổ điển (Good Old Fashioned Artificial Intelligence). (Xem thêm ngữ nghĩa học.) Các phương pháp gồm có:

Trí tuệ tính toán nghiên cứu việc học hoặc phát triển lặp (ví dụ: tinh chỉnh tham số trong hệ thống, chẳng hạn hệ thống connectionist). Việc học dựa trên dữ liệu kinh nghiệm và có quan hệ với Trí tuệ nhân tạo phi ký hiệu, Trí tuê nhân tạo lộn xộn (scruffy AI) và tính toán mềm (soft computing). Các phương pháp chính gồm có:

Người ta đã nghiên cứu các hệ thống thông minh lai (hybrid intelligent system), trong đó kết hợp hai trường phái này. Các luật suy diễn của hệ chuyên gia có thể được sinh bởi mạng neural hoặc các luật dẫn xuất (production rule) từ việc học theo thống kê như trong kiến trúc ACT-R.

Các phương pháp trí tuệ nhân tạo thường được dùng trong các công trình nghiên cứu khoa học nhận thức (cognitive science), một ngành cố gắng tạo ra mô hình nhận thức của con người (việc này khác với các nghiên cứu Công nghệ trí tuê nhân tạo, vì Trí tuê nhân tạo chỉ muốn tạo ra máy móc thực dụng, không phải tạo ra mô hình về hoạt động của bộ óc con người).

Đọc thêm số bài viết trên Callio, để biết thêm về ứng dụng của công nghệ trí tuệ nhân tạo trong tổng đài ảo thông minh (smart call center),

Bài viết có tham khảo từ nguồn: https://vi.wikipedia.org/wiki/Tr%C3%AD_tu%E1%BB%87_nh%C3%A2n_t%E1%BA%A1o